Dự án trí tuệ nhân tạo của Elon Musk, xAI, giới thiệu mô hình ngôn ngữ Grok-1.5 được nâng cấp.

Elon Musk’s artificial intelligence venture, xAI, is garnering attention with the release of an upgraded version of its Grok language model. Dubbed Grok-1.5, this latest iteration boasts a substantially enhanced short-term memory and improved reasoning abilities.

Sức mạnh của bộ nhớ của Grok-1.5

Một khía cạnh chính của việc nâng cấp Grok-1.5 là sự gia tăng đáng kể về dung lượng bộ nhớ ngắn hạn. Trong các mô hình ngôn ngữ lớn (LLMs), bộ nhớ này được đo bằng “tokens“.

Nói một cách đơn giản, token có thể được coi là các đơn vị cơ bản của ý nghĩa trong văn bản, có thể là từ hoặc phần của từ. Grok-1.5 hiện có thể xử lý lên đến 128.000 tokens, tăng gấp 16 lần so với phiên bản trước.

Tại sao dung lượng bộ nhớ mở rộng này quan trọng?

Nó cho phép Grok-1.5 giữ và xử lý các khối thông tin lớn hơn đáng kể trong khi thực hiện nhiệm vụ của mình. Hãy tưởng tượng bạn cố gắng hiểu một hợp đồng pháp lý phức tạp khi chỉ được đọc một đoạn văn duy nhất mỗi lần.

Một trí tuệ nhân tạo có bộ nhớ ngắn hạn mạnh mẽ có thể “nhìn thấy” bức tranh tổng thể, cho phép nó đưa ra các quyết định tốt hơn và tạo ra các phản ứng sâu sắc hơn.

xAI đã tập trung vào khả năng toán học và lập trình của Grok-1.5, dẫn đến cải thiện đáng kể trong hiệu suất trên các thước đo toán học và lập trình.

Bước nhảy trong quá trình suy luận

Bên cạnh việc nâng cao bộ nhớ, Grok-1.5 thể hiện khả năng suy luận cải thiện. Điều này dịch sang khả năng hiểu biết tốt hơn về các mối quan hệ phức tạp giữa các mảnh thông tin và rút ra những kết luận logic.

Đối với người dùng, điều này có nghĩa là Grok-1.5 có thể:

- Hiểu sâu hơn và phức tạp hơn trong một văn bản dài

- Theo dõi một chuỗi hướng dẫn hoặc yêu cầu, ngay cả khi chúng không hoàn toàn theo trình tự tuyến tính

- Cung cấp bản tóm tắt phản ánh chính xác các điểm chính của một tài liệu

Lập trình và tính toán được nâng cấp

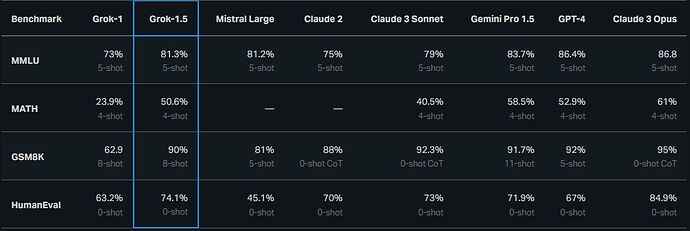

Dường như xAI đã mục tiêu hóa cụ thể vào khả năng toán học và lập trình của Grok-1.5. Theo thử nghiệm của xAI, hiệu suất trên các thước đo đo những kỹ năng này đã được cải thiện đáng kể. Trên thước đo MATH (một bộ sưu tập các vấn đề toán cấp tiểu học và cấp độ thi đấu), Grok-1.5 đạt điểm 50.6%. Nó cũng thể hiện một điểm số 90% trên thước đo GSM8K (một bộ vấn đề toán khác).

Ngoài ra, Grok-1.5 đạt điểm 74.1% trên thước đo HumanEval, đo lường khả năng của trí tuệ nhân tạo trong việc tạo ra mã và giải quyết các vấn đề dựa trên lập trình. Đây là những con số đầy hứa hẹn, tuy nhiên xAI vẫn chưa chi tiết hóa tiến triển hoặc điểm số trong các lĩnh vực kỹ năng khác.

Điều này có thể ý nghĩa gì đối với người dùng?

Mặc dù các chi tiết kỹ thuật của việc nâng cấp của Grok-1.5 rất ấn tượng, nhưng điều này thực sự có ý nghĩa gì đối với người dùng? Dưới đây là một số lĩnh vực tiềm năng mà các cải tiến có thể mang lại lợi ích:

- Phân tích tài liệu: Grok-1.5 có thể được trang bị tốt hơn để tóm tắt các văn bản và báo cáo dài và phức tạp. Điều này có thể tiết kiệm thời gian cho những người cần nắm bắt nhanh chóng nội dung của các tài liệu dài.

- Viết sáng tạo: Khả năng suy luận và bộ nhớ cải thiện có thể cho phép Grok-1.5 tạo ra các định dạng văn bản có cấu trúc và mạch lạc hơn, có thể là các câu chuyện sáng tạo, kịch bản, hoặc thậm chí là thơ ca.

- Giải quyết vấn đề: Khả năng toán học và lập trình tăng cường của trí tuệ nhân tạo có thể giúp cho các nhiệm vụ yêu cầu tính toán hoặc tạo ra mã cho mục đích cụ thể.

Trong so với các mô hình ngôn ngữ lớn khác như GPT-4 và Google Gemini Advanced, dung lượng bộ nhớ tăng của Grok-1.5 mang lại một ưu thế đáng kể

Nhưng liệu nó có thể lật đổ những kẻ khổng lồ?

Hãy phân tích xem dung lượng bộ nhớ của Grok-1.5 so với các đối thủ lớn khác trong lĩnh vực LLM:

- Grok-1.5: Với dung lượng bộ nhớ ngắn hạn lên đến 128.000 token, Grok tự hào về một ưu điểm đáng kể trong phòng ban này.

- GPT-4: Mặc dù con số chính xác chưa được xác nhận công khai, ước tính cho thấy ChatGPT 4 có số lượng token trong hàng nghìn, đáng kể ít hơn so với Grok-1.5.

- Google Gemini Advanced: Mô hình trí tuệ nhân tạo của Google được đồn đoán có số lượng token vượt quá 100.000. Mặc dù vẫn ít hơn so với Grok-1.5, sự khác biệt này nhỏ hơn so với ChatGPT 4.

Mặc dù dung lượng bộ nhớ tăng của Grok-1.5 mang lại một ưu thế đáng chú ý, nhưng điều này không đảm bảo rằng nó có thể lật đổ những kẻ khổng lồ hiện tại như ChatGPT 4 hoặc Google Gemini Advanced. Sự thành công trong lĩnh vực LLM là một sự tương tác phức tạp của các yếu tố.

Cuộc đua tiếp tục

Việc phát hành của Grok-1.5 diễn ra trong thời điểm AI đang tiến triển nhanh chóng. Các công ty và viện nghiên cứu liên tục đẩy giới hạn về những gì mà LLMs có thể làm được.

Đó là một thời điểm thú vị khi sự cạnh tranh thúc đẩy sự đổi mới. Chúng ta nên dự kiến sự hoàn thiện tiếp theo của Grok, và sự giới thiệu của các mô hình trí tuệ nhân tạo hoàn toàn mới, trong tháng và năm tới.

cre: dataconomy